近日,我院在人工智能安全领域取得重要突破,研究成果《Zero-Sacrifice Persistent-Robustness Adversarial Defense for Pre-Trained Encoders》被国际机器学习领域国际顶级会议International Conference on Learning Representations 2026(ICLR 2026)接收。论文第一作者为我院2022级本科生雷竺鑫,通讯作者为杨子元博士和张意教授。

ICLR与ICML、NeurIPS并称为机器学习领域三大国际顶级会议,是该领域最具影响力和前沿性的学术平台,享有极高的学术声誉。此次论文被ICLR接收,标志着我院在模型安全与对抗鲁棒性研究方向上取得的成果获得国际同行的高度认可。

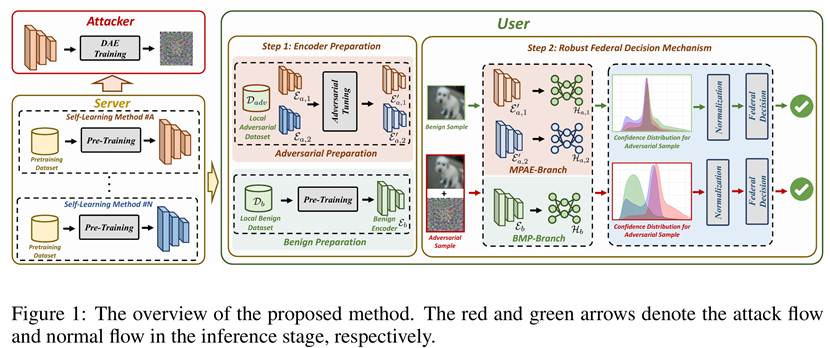

该研究聚焦于预训练编码器在下游任务中面临的“下游无关对抗样本”安全问题。针对现有防御方法需针对不同任务反复微调、且易牺牲模型正常性能的局限,论文创新性地提出了一种零性能牺牲、具备跨任务持续鲁棒性的对抗防御新框架。该方法通过多分支结构与置信度决策机制,仅需一次对抗微调即可实现对多种下游任务的统一高效防御,在保持乃至提升正常样本性能的同时,显著增强了模型对抗攻击的鲁棒性。大量实验结果表明,该方法在多个自监督预训练模型与数据集上均表现优异,在部分实验中正常样本准确率最高提升29.20%,对抗准确率最高提升73.05%,充分体现了“零性能牺牲”的防御特性。

值得一提的是,本次研究成果是我院首次以本科生为第一作者、且所有作者均为本院师生的身份,在机器学习领域三大顶会之一上发表论文,实现了我院在高水平国际学术会议上的又一重要突破,充分展现了学院在人工智能安全领域的人才培养质量与科研创新能力。