近日,我院张意教授团队在数据集蒸馏安全领域的研究成果《Poisoned Distillation: Injecting Backdoors into Distilled Datasets Without Raw Data Access》被人工智能领域国际顶级会议AAAI Conference on Artificial Intelligence(AAAI)收录。AAAI是国际公认的人工智能领域的顶级会议之一,在中国计算机学会推荐会议列表中被评价为A类会议。

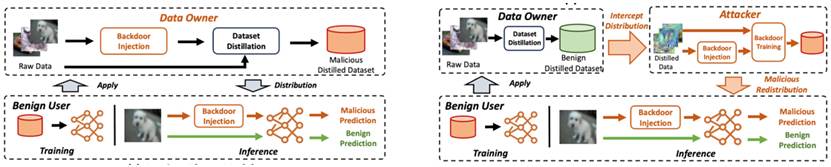

(a) 传统方法威胁模型 (b) 本文的威胁模型

图1. 传统威胁模型和本文威胁模型的比较

数据集蒸馏近年来被视为缓解大规模数据集在计算与存储方面挑战的一种新型技术路径。通过生成能够保留原始数据集关键信息的小规模合成数据,在显著降低数据集大小的同时,仍能保证训练的模型具有类似的性能。

然而,研究发现,数据集蒸馏方法在生成合成数据的过程中容易受到后门攻击的影响。但早期的威胁模型普遍假设攻击者能够访问蒸馏过程以及原始数据。本工作提出了一个更为严格的攻击假设:攻击者无法获取蒸馏过程、原始数据、下游模型,以及下游的训练策略。在这一更具挑战性的假设下,该工作仍然证明攻击者在某些场景中能够在不到一分钟的时间内成功注入后门。

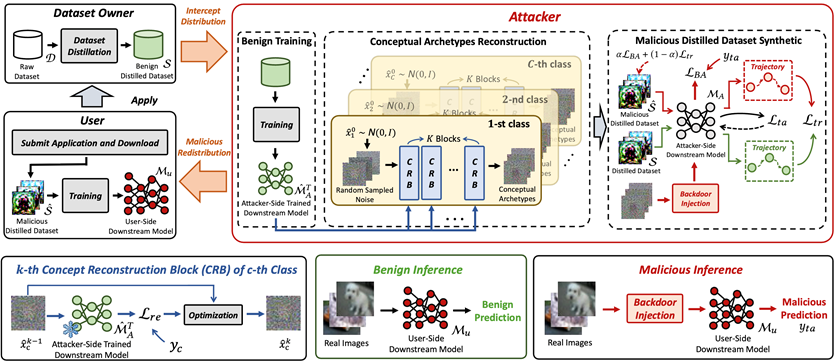

图2. 本文所提方法流程图

本文提出了首个针对上述极具挑战的威胁模型的后门攻击方法。首先利用模型从良性蒸馏数据中学习到的知识,为每个类别重建其概念性原型,作为攻击的基础。随后,在概念原型上注入后门,并且提出一种混合损失函数,在原有优化轨迹上加入后门的唤醒,实现后门能被真实数据稳定触发的同时最大限度降低模型正常性能损失。

该成果联合新加坡先进研究院合作完成,已被AAAI 2026录用,2021级博士生杨子元为第一作者,张意教授为通信作者。

The 40th Annual AAAI Conference on Artificial Intelligence(AAAI)是人工智能领域的顶级国际学术会议,是中国计算机学会(CCF)推荐的A类会议,将于2026年1月20日至27日在新加坡举行。AAAI 2026共收到26380份有效投稿,其中4167篇论文被主会接收,录用率仅为17.6%。

网络空间安全学院

2025年12月4日